Началось обучение языковой модели искусственного интеллекта с открытым исходным кодом на 176 млрд параметров от международной команды разработчиков BigScience.

BigScience main training just started? A large language model created as a tool for research?

Model: 176 billion parameters

?https://t.co/7gz2GibybxData: 46 languages

?https://t.co/EOgshEDrnwCluster: 416 GPU — low carbon energy

?https://t.co/VA1u4OpnVrFollow it live?

— BigScience Research Workshop (@BigscienceW) March 15, 2022

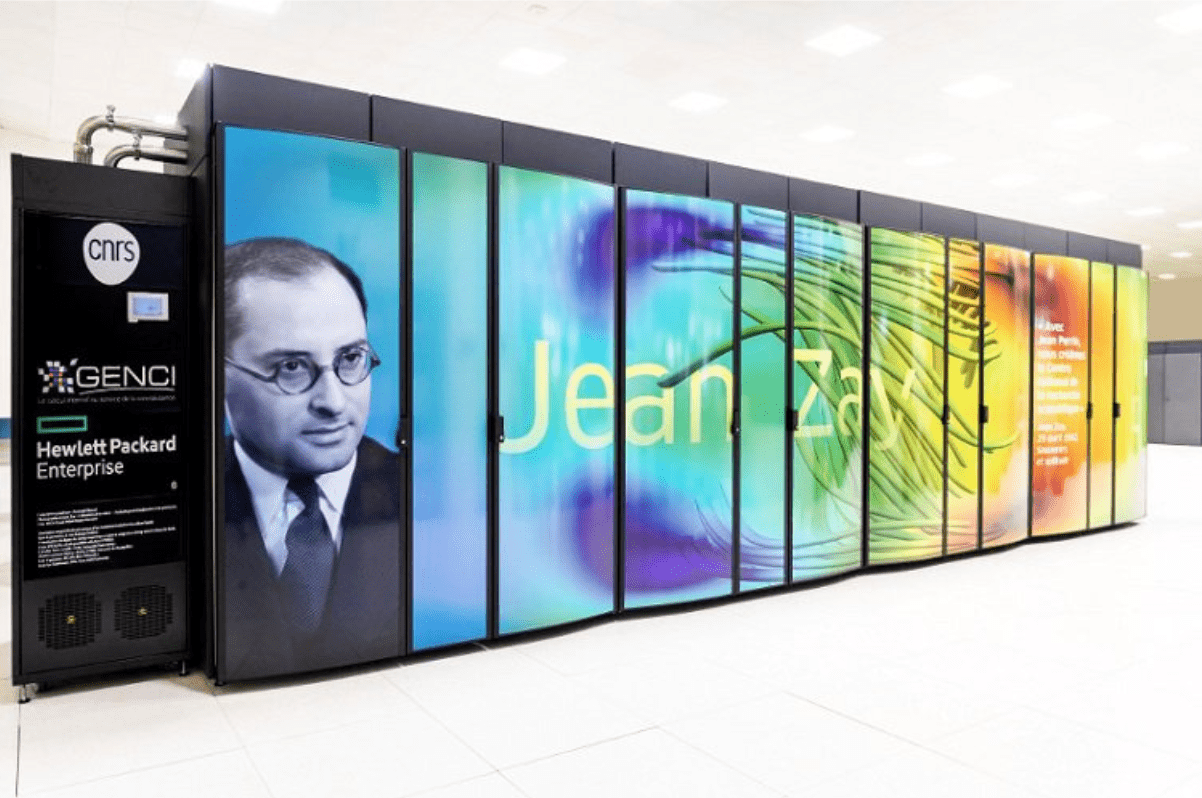

Сейчас алгоритм обучают на данных 46 языков. Работа модель организована на суперкомпьютере Jean Zay французского Института развития и ресурсов в области интенсивных научных вычислений. Он построен на основе видеоускорителей Nvidia V100 и A100. Максимальная производительность установки превышает 28 петафлопс.

По словам руководителя отдела исследований Hugging Face Дау Киела, процесс обучения планируют проводить в период трех-четырех месяцев.

Разработчики создали проект для исследовательских целей. Проприетарные языковые модели компаний вроде OpenAI, Google или Microsoft демонстрируют одинаково проблемное поведение, порождая токсичную речь, предвзятость и дезинформацию, считают инженеры. Алгоритм с открытым исходным кодом поможет исследователям понять эти проблемы и исправить их, добавили они.

«Если мы заботимся о демократизации исследовательского прогресса и хотим убедиться, что весь мир может использовать эту технологию — мы должны найти решение для этого. Это именно то, чем должна заниматься большая наука», — сказал Киела.

В открытом проекте BigScience участвуют более тысячи разработчиков со всего мира, создающих и поддерживающих больших наборов данных для обучения языковых моделей.

Не купил крипту по низу рынка?

Попробуй свои силы бесплатно и выигрывай криптовалюту в лучших рекомендованных казино! Наш сайт wheretospin.com предлагает не только лучшие обзоры казино, но и возможность испытать удачу в захватывающих играх.

Присоединяйся прямо сейчас и начни путь к финансовой свободе с WhereToSpin!

Middle East

wheretospininkuwait.com provides a comprehensive selection of trusted online casino reviews for the Middle East أفضل كازينو على الإنترنت. The platform features well-established casinos supporting crypto deposits in the region, including Dream Bet, Haz Casino, Emirbet, YYY Casino, and Casinia.

South Africa and New Zealand

In the South African online casino market, wheretospin.co.za highlights top-rated platforms and online casinos such as True Fortune Casino and DuckyLuck. Meanwhile, for New Zealand players, wheretospin.nz showcases highly recommended casinos, including Casinia, Rooster.bet, and Joo Casino.